Geen zin, grijs en stil? Een chat met een AI-systeem kan bepalen wat je dwarszit en helpen bij milde depressieklachten. Het vervangt geen psycholoog, zegt Franziska Burger.

(Illustratie: Auke Herrema)

De derde maandag van januari staat bekend als Blue Monday. Regenachtig guur weer, lang donker en de goede voornemens zijn inmiddels gestrand. Dr. Franziska Burger ontwikkelde tijdens haar promotieonderzoek bij de faculteit Elektrotechniek, Wiskunde en Informatica (EWI) een artificial intelligence (AI)-systeem tegen depressies.

Eerder had ze een opleiding gedaan in kennistheorie (bachelor cognitive sciences, Tübingen) en in kunstmatige intelligentie (master AI Nijmegen). Tijdens haar promotieonderzoek bij prof.dr. Mark Neerincx en dr.ir. Willem-Paul Brinkman (EWI) bracht ze die twee richtingen bij elkaar in het ontwerp van een AI-systeem dat cognitieve therapie van depressie kan ondersteunen.

Vanwaar die keuze?

Franziska Burger: “Promovendi hebben meer dan gemiddeld last van depressieklachten. Toen ik begon zat dat op 30 procent van alle promovendi en dat is met Covid nog gestegen. Daarom wilden we wat doen voor promovendi, maar nu is het wat breder geworden. De gesprekstechniek die we gebruiken is vrij simpel. Die wordt ook als huiswerk meegegeven aan patiënten.”

Ik begrijp dat er een soort chat plaatsvindt met een computer die uit iemands antwoorden kan achterhalen wat er aan de hand is?

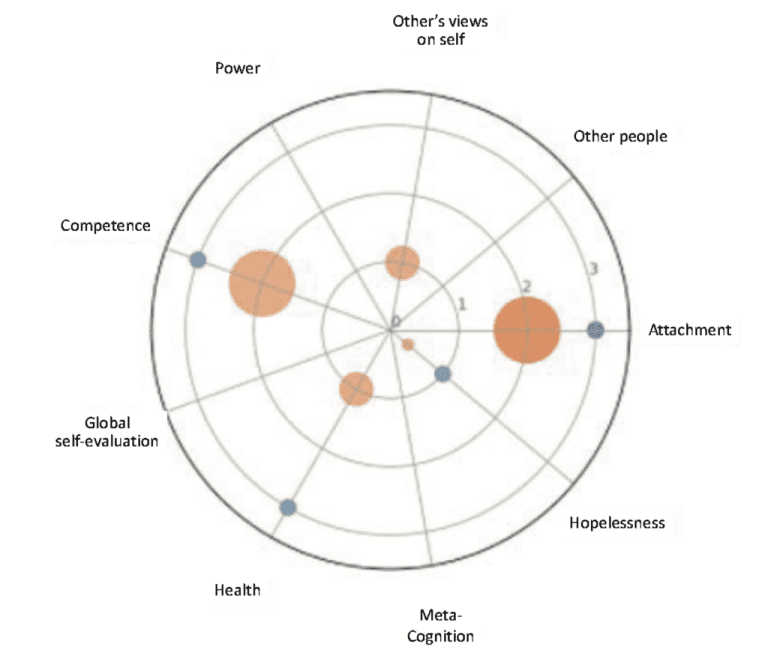

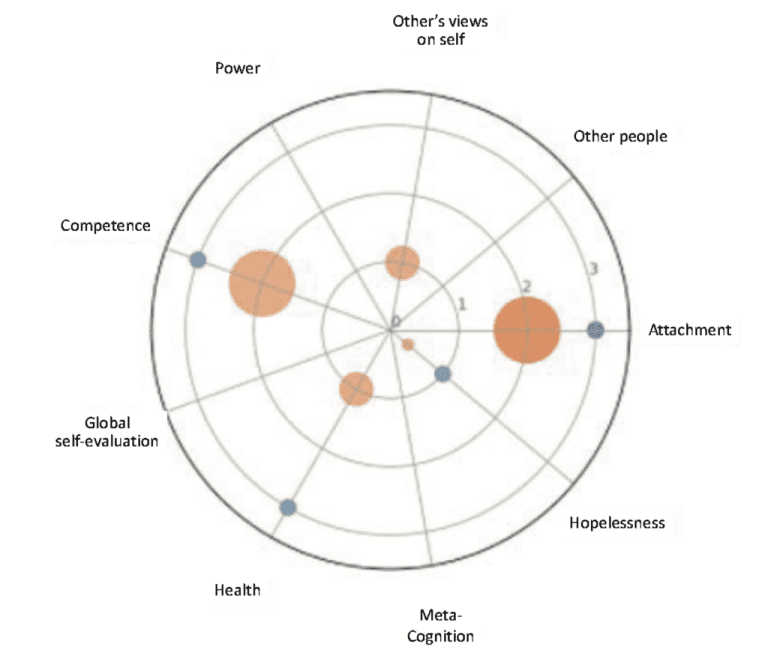

“Het was de bedoeling om met AI automatisch te kijken wat er bij iemand speelt. Dat kan helpen met de stap naar zelfkennis – het begin van iedere verbetering. Omdat je die chatsessies na enige tijd herhaalt wordt het systeem steeds zekerder over wat er speelt. ‘State the emotion you felt in this situation in one or two words’, vraagt het dan. We laten zien of een schema herhaald terugkomt en in welke intensiteit op een schaal van 0 tot 3. Die waarde weerspiegelt de zekerheid van het AI-algoritme.”

‘Het effectiefst is als het AI-systeem de gewone therapie ondersteunt’

Een ‘schema’ is een bepaald denkpatroon dat vanuit de psychologie bekend is als achterliggend patroon bij depressieve klachten. Veel angsten en onzekerheden zijn terug te voeren op negen kernbegrippen, of een combinatie ervan: binding, competentie, zelfvertrouwen, gezondheid, macht, zelfkennis, andere mensen, hopeloosheid, mening van anderen. Aan de hand van iemands uitingen in een chat bepaalt het AI-systeem de samenhang met een of meerdere van die denkpatronen en presenteert die in een soort radarscherm.

De ‘spider plot’ is een soort radarscherm van negatieve gedachten. Blauwe punten geven de analyse van de meest recente chat in de vorm van gerelateerde denkpatronen (binding, gezondheid en hopeloosheid). De oranje punten geven het resultaat van alle voorgaande chats. (Illustratie: Franziska Burger)

Gaat het AI algoritme verder dan het vaststellen van onderliggende schema’s? Komt het bijvoorbeeld ook met remedies of tips?

“Zo ver zijn we niet gegaan maar het zou een vervolgstap kunnen zijn. Een therapeut zal proberen iemands denkpatroon positief te maken. Die stap hebben wij niet gezet.”

Zie je een rol voor een AI-algoritme in de overbelaste geestelijke gezondheidszorg?

“Dat is vooralsnog hooguit een ondersteunende rol. Het effectiefst is als het AI-systeem de gewone therapie ondersteunt. De therapeut geeft vaak huiswerk mee dat de patiënt thuis moet invullen. Een AI-systeem kan daarbij automatische feedback geven. Dat geeft de therapeut extra informatie en de patiënt krijgt terugkoppeling.”

Ons werk is meer op samenwerking gericht dan op vervanging

Op wat voor manier kan AI dat huiswerk aantrekkelijker maken?

“Veel van de gebruikte systemen lijken erg op een papieren versie of op een zelfhulpboek, maar dan op een website. Heb je daar echt iets mee gewonnen? Ik vind van niet. AI kan de dialoog slimmer, interessanter en leuker te maken door goede feedback. Dat kan een chat een stuk aantrekkelijker maken. Zo kijk ik ernaar.”

Zijn er psychologen betrokken geweest bij de ontwikkeling van het systeem?

“We hebben voorafgaand aan het onderzoek gesprekken met cognitieve psychologen gevoerd en die hebben ons op het spoor gezet van de schema’s. Ook bij het coderen van woorden naar schema’s waren coders betrokken met een psychologie-achtergrond. Zij hebben de data van labels voorzien. En daarmee hebben wij de AI getraind.”

In je inleiding noem je het capaciteitsprobleem in de geestelijke gezondheidszorg (GGZ) als motivatie voor dit project. Hoe kijk je daar nu tegenaan?

“Je ziet een verschuiving van reguliere naar preventieve GGZ. Bij preventieve zorg heb je minder risico’s want je gaat ervanuit dat je met gezonde mensen werkt. Daar kun je AI inzetten want de risico’s zijn klein en het kan mensen helpen met het verwerven van zelfkennis als je het AI-systeem op een verantwoorde manier ontwikkelt en test.”

En voor depressiepatiënten?

“Ik denk dat AI wel op een verantwoorde manier in te zetten is bij depressieve patiënten maar dan moet er wel goed begrepen worden wat de AI doet. Ook zou het nuttig zijn als er een therapeut bij betrokken is die helpt met de interpretatie en het bespreken van wat de AI allemaal uitspuugt. Ik zou dus bij zware depressie geen stand alone AI-gebaseerd chatsysteem inzetten. Daarvoor is het model dat we nu hebben ontwikkeld te basic en zijn de risico’s te groot.”

Dus de psychiater kan nog niet vervangen worden door een AI-systeem?

“Nee, en daar zijn we ook niet op uit. Ons werk is meer op samenwerking gericht dan op vervanging.”

- Download een voorbeeldchat tussen het AI-systeem en een vrijwilliger uit de veldtest.

- Franziska Burger, Supporting Electronic Mental Health with Artificial Intelligence, download proefschrift

Heb je een vraag of opmerking over dit artikel?

j.w.wassink@tudelft.nl

Comments are closed.